Google Research hat TurboQuant veröffentlicht, einen neuen Kompressionsalgorithmus für große Sprachmodelle. Laut des Unternehmens lässt sich der Key-Value-Cache eines Modells damit auf mindestens ein Sechstel reduzieren. Zudem wird die Attention-Berechnung – ein zentraler Verarbeitungsschritt – um das bis zu Achtfache beschleunigt, ohne dass das Modell neu trainiert werden muss oder an Präzision verliert.

Um zu verstehen, warum das wichtig ist, hilft ein kurzer Blick auf den Key-Value-Cache. Wenn ein KI-Modell einen langen Text verarbeitet, speichert es Informationen zu jedem Wort als eine Liste von Zahlen, einen sogenannten Vektor. Bei langen Texten oder Gesprächen häufen sich diese Vektoren im Arbeitsspeicher und verlangsamen das Modell. Kompressionsverfahren können Vektoren verkleinern, aber die meisten bestehenden Methoden erzeugen eigenen Mehraufwand: Sie benötigen zusätzliche Referenzzahlen, die neben den komprimierten Daten gespeichert werden müssen, was die Einsparungen teilweise wieder zunichte macht.

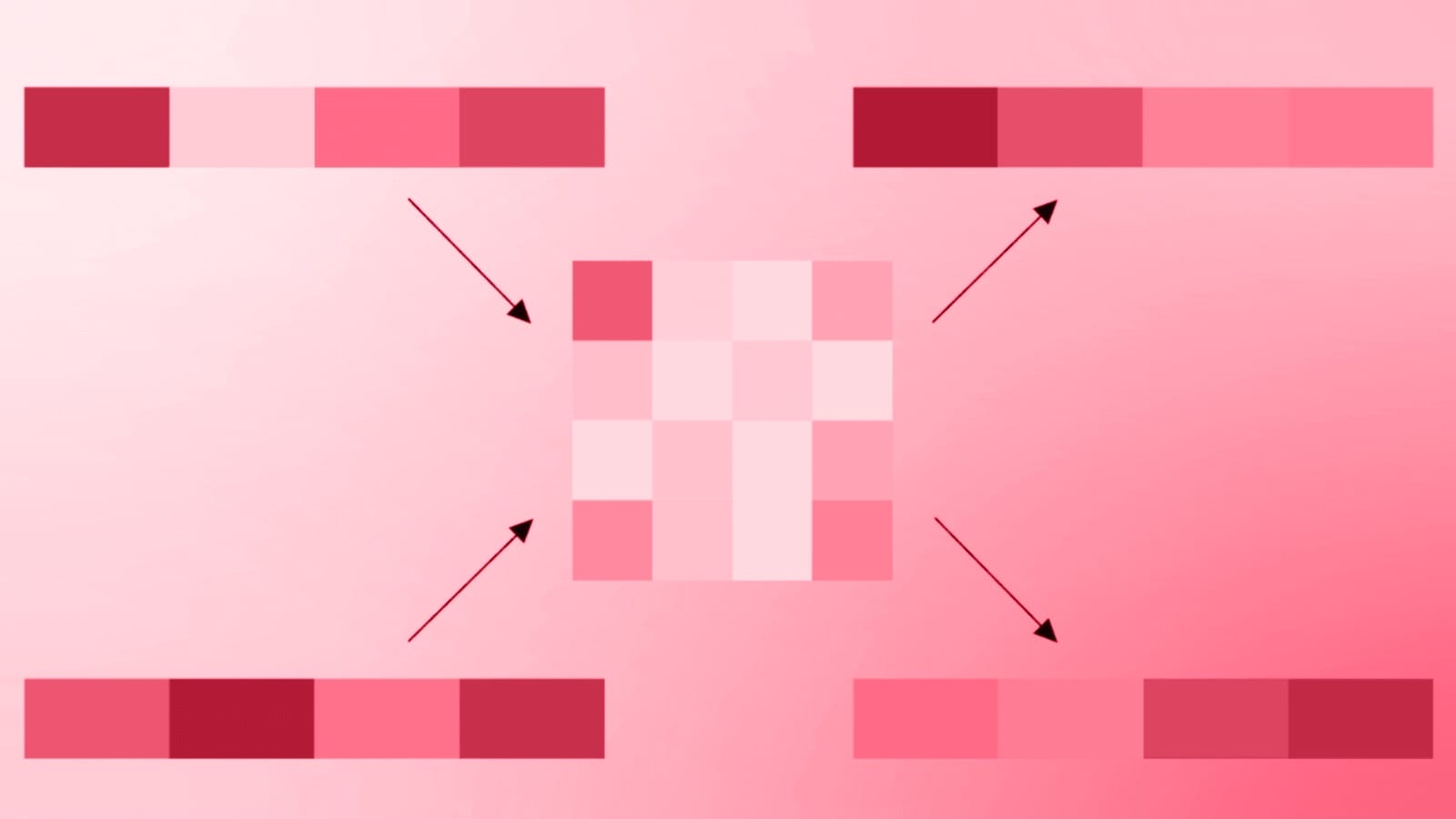

TurboQuant löst dieses Problem in zwei Schritten. Der erste Schritt nutzt eine begleitende Methode namens PolarQuant. Anstatt einen Vektor mit standardmäßigen Koordinaten zu beschreiben, wandelt PolarQuant ihn in Polarkoordinaten um. Das entspricht der Idee, einen Zielort mit Entfernung und Richtung zu beschreiben, anstatt mit Gitterpunkten. Nach einer zufälligen mathematischen Drehung der Daten werden die Winkel in dieser Darstellung so vorhersehbar, dass das System die aufwendigen Referenzzahlen nicht mehr speichern muss. Im zweiten Schritt kommt eine Methode namens Quantized Johnson-Lindenstrauss (QJL) zum Einsatz. Sie reduziert den verbleibenden Fehler auf ein einziges Bit pro Zahl und verhindert so, dass sich kleine Ungenauigkeiten anhäufen.

Google Research hat alle drei Algorithmen anhand gängiger Benchmarks für lange Kontexte getestet.

Zu den Tests gehörten:

- Needle in a Haystack: Kann das Modell einen einzelnen Satz in 100.000 Wörtern finden?

- LongBench: Aufgaben wie Fragen beantworten, Code schreiben und Zusammenfassen

- RULER und ZeroSCROLLS: Weitere Standardtests für lange Kontexte

TurboQuant erzielte dabei vollständige Trefferquoten und reduzierte den Speicherbedarf. Auf NVIDIA-H100-Hardware erreichte die Vier-Bit-Version von TurboQuant bei der Attention-Berechnung eine achtfache Beschleunigung gegenüber dem herkömmlichen 32-Bit-Verfahren.

Die Algorithmen sind kostenlos verfügbar und erfordern kein zusätzliches Training. Unternehmen können sie also auf bestehende Modelle anwenden, ohne diese neu aufzubauen. Google Research zufolge funktionieren die Methoden mit mehreren Open-Source-Modellen, darunter Llama, Mistral und Gemma.

Unabhängige Tests bestätigen die Ergebnisse bereits. Ein früher Benchmark, der auf X veröffentlicht wurde, zeigte, dass eine 2,5-Bit-Version von TurboQuant den Key-Value-Cache eines Drittanbietermodells um fast das Fünffache verkleinerte, ohne messbare Genauigkeitsverluste.

Nach der Veröffentlichung fielen die Aktienkurse von Speicherchipherstellern wie Micron und Western Digital. Börsenhändler spekulierten, dass softwarebasierte Kompression die Nachfrage nach physischem Speicher senken könnte.

Quellen: Google Research Blog, VentureBeat

Bleib auf dem Laufenden

KI für Contentprofis: die neuesten Tools, Tipps und Trends. Alle 14 Tage in deine Inbox: