Google TurboQuant kann KI-Kosten spürbar verringern

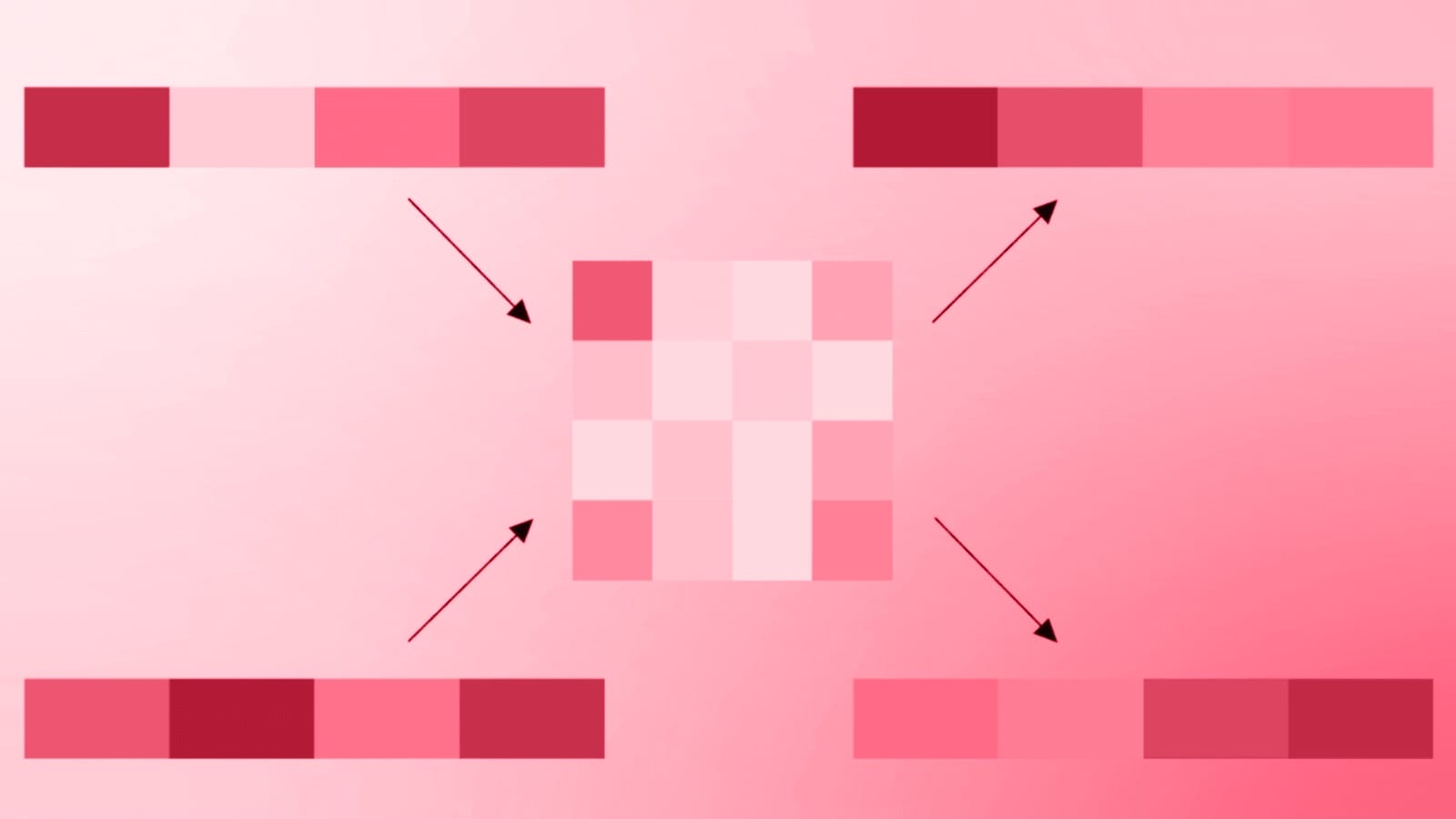

Google Research hat TurboQuant veröffentlicht, einen neuen Kompressionsalgorithmus für große Sprachmodelle. Laut des Unternehmens lässt sich der Key-Value-Cache eines Modells damit auf mindestens ein Sechstel reduzieren. Zudem wird die Attention-Berechnung – ein zentraler Verarbeitungsschritt – um das bis zu Achtfache beschleunigt, ohne dass das Modell neu trainiert werden muss oder an Präzision verliert. Um zu …